「LLM って結局なに?」と検索してこの記事にたどりついた方へ。一言で答えると、**LLM は「大量の文章を学習して、次に来る単語を予測しているAI」**です。ChatGPT も Claude も Gemini も、中身はすべて LLM です。

この記事では、LLM の仕組みを 5 分で理解できるよう、専門用語を最小限にして解説します。できることだけでなく、**ハルシネーション(もっともらしい嘘)**などの苦手な部分まで含めて整理します。

結論:3行まとめ

- LLM は Large Language Model(大規模言語モデル)の略で、大量の文章を学習したAIモデル

- やっていることはシンプルで「次に来る単語の予測」を超高速で繰り返している

- 文章生成・要約・翻訳・コード補助などが得意。一方で、事実の正確性や最新情報には弱い

LLMとは ― 「次の単語」を予測するAI

LLM は 大量の文章データを学習して、もっともそれらしい続きの単語を予測するAIモデルのことです。

普段使っている ChatGPT、Claude、Gemini はすべて、この LLM を中身に持つサービスです。**「LLM = 中身(モデル本体)」「ChatGPT = 中身を使った製品」**と整理すると、混乱が減ります。

「大規模」と呼ばれる理由は、主に次の 2 つです。

- 学習データが膨大:Web ページ・書籍・論文・コードなど、数兆単語にのぼると言われる規模のテキストを学習している

- パラメータ数が膨大:モデル内部の調整パラメータも、公開されている主要モデルでは数百億〜数兆規模が報告されている

数字の話は深入りしませんが、「ものすごく大きい辞書のようなもの」と捉えれば十分です。

LLMの仕組み ― 「次の単語予測」が知能に見える理由

学習フェーズ:文章の穴埋めを超大量にやる

LLM のトレーニングは、ざっくり言うと 巨大な穴埋め問題のドリルです。

たとえば「今日は天気が __ です」という文があれば、空欄に「いい」「悪い」「快晴」など、もっともらしい単語を当てる練習を繰り返します。これを Web 上の大量の文章で行うと、文法や知識、文脈の流れがモデルの内部に刻まれていきます。

推論フェーズ:プロンプトに対して続きを生成する

学習が終わったモデルに、私たちが質問(プロンプト)を投げると、モデルは 「この文の続きとして自然な単語」 を 1 つずつ生成していきます。

「日本の首都は」と入力すれば「東京」が続く確率が高いと判断する、という仕組みです。これが何百単語と続いて、まとまった回答に見えるわけです。

なぜ「会話」できるように見えるのか

LLM は内部で会話の意図を理解しているわけではなく、**「指示文に対して自然な応答が続く文章を予測している」**だけです。それでも会話として成立して見えるのは、学習データに膨大な対話パターンが含まれているからです。

ここまでの仕組みは Transformer(トランスフォーマー)というニューラルネットワーク構造の上に成り立っています。詳細は別記事で扱う予定なので、今は「Transformer = LLM の土台になっている設計図」とだけ覚えておけば十分です。

LLMでできること5選

実用上、LLM は次のような場面で力を発揮します。

1. 文章生成・要約・翻訳

メールの下書き、議事録の要約、英語記事の翻訳など、テキストを「整える・変換する」作業全般が得意です。

2. 質問応答(Q&A)

学習済みの一般知識に対する Q&A は得意分野です。ただし、最新の出来事や個別具体の数値は誤ることがあります(後述)。

3. 分類・抽出

メールを「重要 / 通常 / スパム」に分けたり、文書から日付や金額を抽出したりする、業務寄りのタスクにも使えます。

4. コード生成・コード補助

プログラミング言語も大量に学習しているため、コードのドラフト生成、バグの説明、リファクタリングの提案などに役立ちます。

5. 対話(チャット形式)

複数ターンのやりとりを通じて、考えを整理する壁打ち相手のような使い方もできます。

LLMが苦手なこと・限界

LLM は万能ではありません。メリットだけを信じて使うと、実務で痛い目を見ます。代表的な限界を整理します。

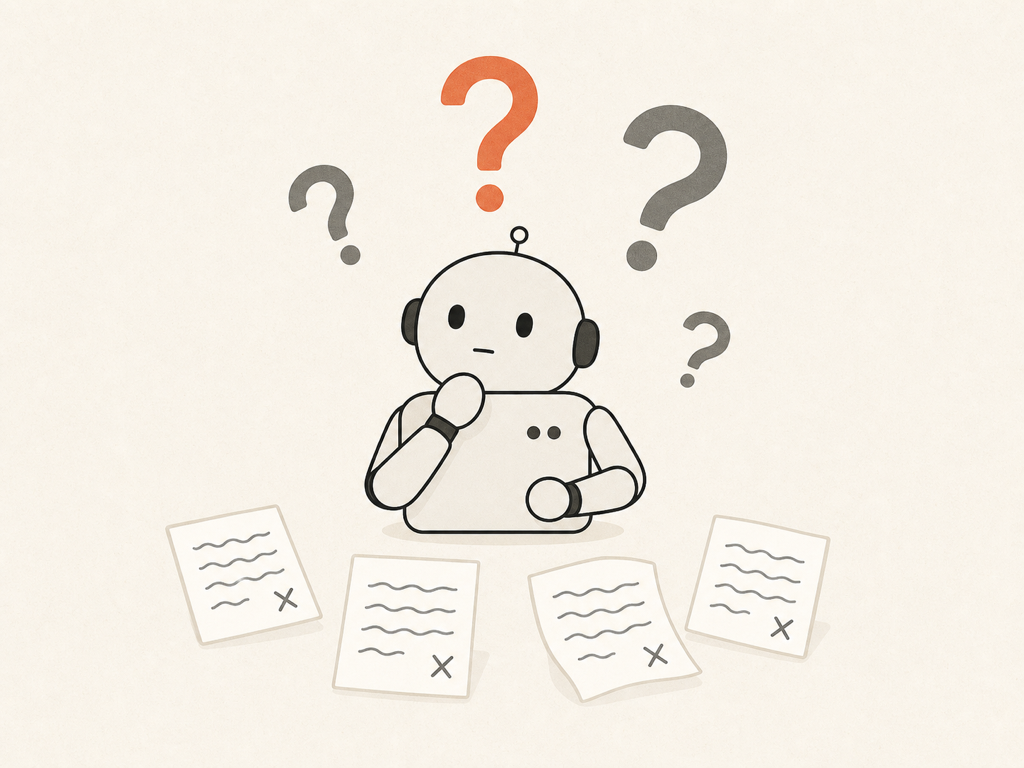

事実誤認(ハルシネーション)

LLM は「もっともらしい単語」を予測するため、実際には存在しない情報をそれっぽく作り出すことがあります。これをハルシネーション(幻覚)と呼びます。

事実の正確性が重要な用途では、一次情報での裏取りが欠かせません。

学習データのカットオフ問題

LLM は「学習を完了した時点」までの情報しか持っていません。最新ニュース・直近のリリース情報・現在の株価などは、原則として答えられません(Web 検索を組み合わせるサービスは別)。

計算や厳密な論理処理

電卓のような正確な計算や、複雑な論理推論は苦手です。最近のモデルは内部で計算ツールを呼び出す機能を備えていますが、過信は禁物です。

一貫性・文脈長の制約

長い対話を続けると、最初に伝えた前提を忘れたり、矛盾する内容を返したりすることがあります。一度に扱える情報量(文脈長 / context length)にも上限があります。

主要なLLMの種類

| 種類 | 例 | 特徴 |

|---|---|---|

| 商用クローズド | GPT(OpenAI)/ Claude(Anthropic)/ Gemini(Google) | 性能が高く、API・チャットサービスとして提供されている |

| オープンソース | Llama(Meta)/ Mistral / Qwen | モデル自体が公開されており、自社環境で動かせる |

| マルチモーダル | GPT-4o / Gemini / Claude 4.7 など | テキストに加えて画像・音声なども扱える |

各モデルの詳しい違いは「ChatGPT・Claude・Gemini の違い完全比較」(公開予定)で扱います。

LLMを使うときに知っておきたい3つの注意点

1. 機密情報を入力しない

入力したデータが将来の学習に使われる可能性がゼロとは言い切れません。社外秘情報や個人情報は、契約条件を確認したうえで、原則入力しない設計が安全です。

2. 出力をそのまま信じない

ハルシネーションがあるため、重要な判断につながる情報は人間がレビューする運用が前提です。コードであれば動作確認、文章であれば事実確認、というひと手間を挟むのが安全です。

3. バイアスは避けられない

LLM は学習データに含まれる偏りをそのまま反映します。性別・国籍・職業などに関する出力は、特定の傾向を持つ可能性があると意識して使う必要があります。

まとめ ― LLMは「賢い文章予測エンジン」

最後にもう一度、要点を整理します。

- LLM は 大量の文章を学習して「次の単語」を予測するAIモデル

- ChatGPT・Claude・Gemini は LLM をベースにしたサービス

- できること:文章生成・要約・翻訳・Q&A・分類・コード補助・対話

- 苦手なこと:事実誤認(ハルシネーション)・最新情報・厳密な計算・長い文脈の一貫性

「賢い文章予測エンジン」と捉えると、LLM の振る舞いは驚くほど予測しやすくなります。万能ではないと知ったうえで使えば、業務でも生活でも頼れる相棒になります。

次に読む

- 「ChatGPT・Claude・Gemini の違い完全比較」(公開予定)― 主要 LLM サービスを並べて整理

- 「プロンプトエンジニアリング基本の型 5 選」(公開予定)― LLM を上手く使うためのコツ